负载均衡是我们大流量网站要做的一个东西,下面我来给大家介绍在 Nginx 服务器上进行负载均衡配置方法,希望对有需要的同学有所帮助哦。

负载均衡

先来简单了解一下什么是负载均衡,单从字面上的意思来理解就可以解释 N 台服务器平均分担负载,不会因为某台服务器负载高宕机而某台服务器闲置的情况。那么负载均衡的前提就是要有多台服务器才能实现,也就是两台以上即可。

测试环境

1、由于没有服务器,所以本次测试直接 host 指定域名,在同一台机器上使用 IIS 创建两个站点。

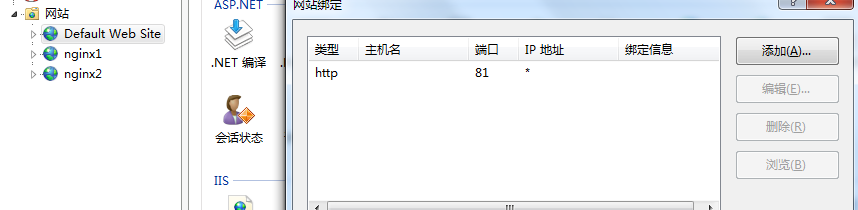

2、nginx 与 iis 的默认端口都是 80,这里使用 nginx 做负载均衡,所以需要改变 iis 的默认端口, 这里我把 IIS 的默认端口改成了 81

测试域名 :a.com

A服务器IP :192.168.5.149 (主)

B服务器IP :192.168.5.27

C服务器IP :192.168.5.126

部署思路

A服务器做为主服务器,域名直接解析到A服务器(192.168.5.149)上,由A服务器负载均衡到B服务器(192.168.5.27)与C服务器(192.168.5.126)上。

域名解析

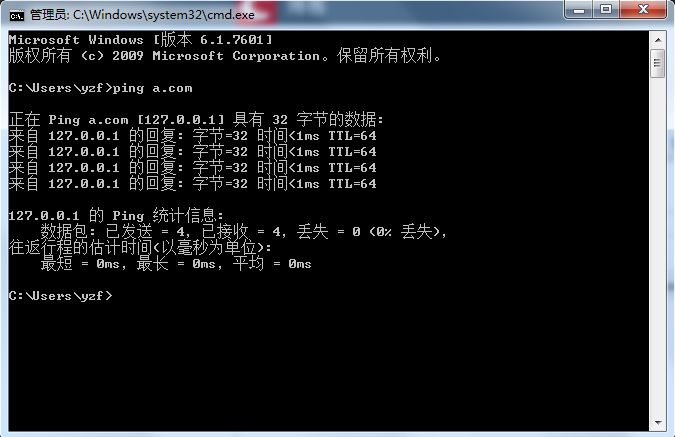

由于不是真实环境,域名就随便使用一个 a.com 用作测试,所以 a.com 的解析只能在 hosts 文件设置。

打开:C:Windows\System32\drivers\etc\hosts

在末尾添加

192.168.5.149 a.com保存退出,然后启动命令模式 ping 下看看是否已设置成功

从截图上看已成功将 a.com 解析到 127.0.0.1

nginx.conf 设置

打开 nginx.conf,文件位置在 nginx 安装目录的 conf 目录下。

在 http 段加入以下代码

upstream a.com {

server 192.168.5.126:80;

server 192.168.5.27:80;

}

server{

listen 80;

server_name a.com;

location / {

proxy_pass http://a.com;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

}

}

保存重启 nginx

B、C服务器nginx.conf设置

打开nginx.confi,在http段加入以下代码

server{

listen 80;

server_name a.com;

index index.html;

root /data0/htdocs/www;

}保存重启nginx

测试

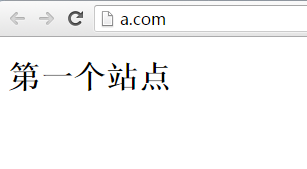

当访问 a.com 的时候,为了区分是转向哪台服务器处理我分别在 b,c 站点下写一个不同内容的 index.html 文件,以作区分。

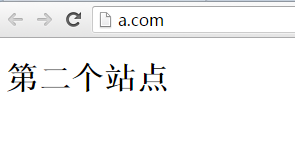

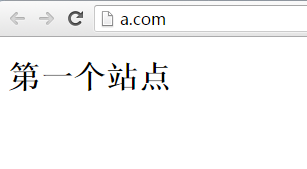

打开浏览器访问 a.com 结果,刷新会发现所有的请求均分别被分配到 B 站点(192.168.5.149)与 C 服务器(192.168.5.126)上,实现了负载均衡效果。

B 站点处理页面

c 站点处理页面

假如其中一个站点停止了会怎样?

当某个站点停止了,是否会影响访问呢?

我们先来看看实例,根据以上例子,假设C服务器192.168.5.126这台机子宕机了(由于无法模拟宕机,所以我就把C服务器关机)然后再来访问看看。

访问结果:

我们发现,虽然C服务器(192.168.5.126)宕机了,但不影响网站访问。这样,就不会担心在负载均衡模式下因为某台机子宕机而拖累整个站点了。

如果b.com也要设置负载均衡怎么办?

很简单,跟a.com设置一样。如下:

假设b.com的主服务器IP是192.168.5.149,负载均衡到192.168.5.150和192.168.5.151机器上

现将域名b.com解析到192.168.5.149IP上。

在主服务器(192.168.5.149)的nginx.conf加入以下代码:

upstream b.com {

server 192.168.5.150:80;

server 192.168.5.151:80;

}

server{

listen 80;

server_name b.com;

location / {

proxy_pass http://b.com;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

}

}

保存重启nginx

在192.168.5.150与192.168.5.151机器上设置nginx,打开nginx.conf在末尾添加以下代码:

server{

listen 80;

server_name b.com;

index index.html;

root /data0/htdocs/www;

}保存重启nginx

完成以后步骤后即可实现b.com的负载均衡配置。

主服务器不能提供服务吗?

以上例子中,我们都是应用到了主服务器负载均衡到其它服务器上,那么主服务器本身能不能也加在服务器列表中,这样就不会白白浪费拿一台服务器纯当做转发功能,而是也参与到提供服务中来。

如以上案例三台服务器:

A服务器IP :192.168.5.149 (主)

B服务器IP :192.168.5.27

C服务器IP :192.168.5.126

我们把域名解析到A服务器,然后由A服务器转发到B服务器与C服务器,那么A服务器只做一个转发功能,现在我们让A服务器也提供站点服务。

我们先来分析一下,如果添加主服务器到upstream中,那么可能会有以下两种情况发生:

1、主服务器转发到了其它IP上,其它IP服务器正常处理;

2、主服务器转发到了自己IP上,然后又进到主服务器分配IP那里,假如一直分配到本机,则会造成一个死循环。

怎么解决这个问题呢?因为80端口已经用来监听负载均衡的处理,那么本服务器上就不能再使用80端口来处理a.com的访问请求,得用一个新的。于是我们把主服务器的nginx.conf加入以下一段代码:

server{

listen 8080;

server_name a.com;

index index.html;

root /data0/htdocs/www;

}

重启nginx,在浏览器输入a.com:8080试试看能不能访问。结果可以正常访问

既然能正常访问,那么我们就可以把主服务器添加到upstream中,但是端口要改一下,如下代码:

upstream a.com {

server 192.168.5.126:80;

server 192.168.5.27:80;

server 127.0.0.1:8080;

}由于这里可以添加主服务器IP192.168.5.149或者127.0.0.1均可以,都表示访问自己。

重启Nginx,然后再来访问a.com看看会不会分配到主服务器上。

主服务器也能正常加入服务了。

最后

一、负载均衡不是 nginx 独有,apache,IIS 也可以实现负载均衡,但性能可能不如 nginx。

二、多台服务器提供服务,但域名只解析到主服务器,而真正的服务器 IP 不会被 ping 下即可获得,增加一定安全性。

三、upstream 里的 IP 不一定是内网,外网 IP 也可以。不过经典的案例是,局域网中某台 IP 暴露在外网下,域名直接解析到此 IP。然后又这台主服务器转发到内网服务器 IP 中。

四、某个站点无法访问、不会影响网站正常运行,Nginx 不会把请求转发到已停止的站点

Comments | NOTHING